——一个 AI 时代的个人 Agent 系统实践手记

引言:时代的两个锚点

过去一年,AI 领域有两个里程碑:

2025.01 DeepSeek:打破了模型智力的垄断,让每个人都用得起顶级大脑——这是普惠的「脑」。

2026 OpenClaw:打破了 AI 应用的孤岛,让 AI 真正接管了我们的数字生活——这是普惠的「手」。

“Your assistant. Your machine. Your rules.”

OpenClaw 是什么?

它不仅仅是一个 ChatBot,而是 AI Native OS。

我的观点是:OpenClaw + 任何现有 OS(Linux / Mac / Windows)= 真正的 AI OS。

我深度使用 OpenClaw一个多月, 包括看春晚的过程中。这篇文章,就是我想把这段日子的思考和实践,分享给你们的记录。

左边跟OpenClaw聊,右边用Claude Code改造OpenClaw

一、为什么我们需要「自己的 AI 助手」?

1.1 云的「智能」与「束缚」

想想我们用 ChatGPT、Claude、Kimi’s 的日常——它们确实很强,但总有一些「不舒服」的时刻:

- 数据安全:有些话、有些文件,你不想发给云端

- 定制化:你想让它按你的习惯工作,但它总是一副「标准化服务」的嘴脸

- 工具割裂:一个 AI 负责聊天,另一个负责搜索,另一个负责写代码——它们之间「老死不相往来」

- 成本焦虑:每次调用都是钱,而且你不知道它什么时候会悄悄涨价

这些问题,OpenClaw 给了一个完全不同的答案。

1.2 本地化的「掌控感」

OpenClaw 跑在自己的电脑上,所有数据都在自己手里。

OpenClaw 给了我**「组装能力」**——我可以让它连接 Telegram、连接企业微信、让它帮我处理各项任务、让它记住我的偏好、甚至让它扮演不同的人格来陪我聊天。

这不再是「租用一个 AI」,而是「拥有一个 AI 系统」。

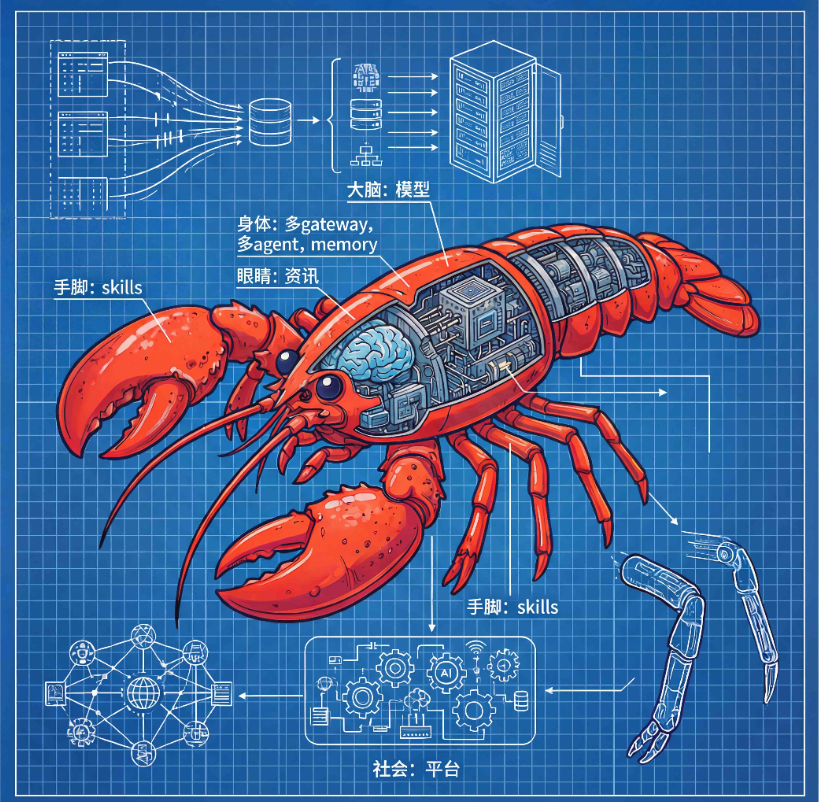

二、核心架构:三个组件 + 核心执行能力

说到技术层面,OpenClaw 的设计堪称优雅。它由三个核心组件组成,加上核心执行能力,完成了从「对话」到「执行」的跨越。

2.1 Gateway:幕后的「总调度」

Gateway 是整个系统的控制平面,不是一个简单的 API 网关,而是一个长期运行的 Node.js 进程,7×24 小时待命。

它的职责包括:

- 渠道管理:同时连接 Telegram、企微、Discord、Slack、WhatsApp…

- 会话管理:记住你是谁、你之前说过什么

- Agent 循环:接收消息 → 调用模型 → 决策 → 执行 → 返回结果

- 记忆持久化:把重要的事情写入磁盘,防止「断电即忘」

我第一次理解 Gateway 的价值,是在我需要同时在 Telegram 和企业微信上跟它对话的时候。传统 AI 需要你在每个平台单独配置,但 OpenClaw 的 Gateway 天然支持「一套系统、多端接入」。

2.2 Language Model:可插拔的「大脑」

OpenClaw 本身不包含 AI 模型,它更像是一个**「插座」**,你可以插入任何符合规范的「插头」。

目前支持的主流模型:

- Anthropic Claude:最强王者,适合复杂推理

- OpenAI GPT:生态最丰富

- Google Gemini:多模态能力突出

- MiniMax:国产之光,性价比高

更有意思的是 「模型容灾」——你可以配置多个模型,当一个模型调用失败(比如 API 挂了),它会自动切换到备用模型。

2.3 Skills System:预设的「工具箱」

Skills 是 OpenClaw 的插件系统,让 AI 能调用预定义的能力。

| 技能 | 作用 |

|---|---|

| browser | 浏览器控制 |

| read/write | 文件读写 |

| message | 发送消息 |

| cron | 定时任务 |

| … | … |

2.4 Core Tools:核心执行能力(让 AI 真正「干活」)

如果说 Skills 是「预设的工具箱」,那 Core Tools 就是那把**「瑞士军刀」**——遇到新需求不用提前写 Skill,直接命令行搞定。

但 OpenClaw 背后的执行能力远不止于此——它依赖于一个更底层的开源项目:Pi。

Pi 是什么?

Pi (badlogic/pi-mono) 是一个极简主义的终端编程 Agent,它是 OpenClaw 的底层执行器,你可以把它理解成Claude Code的开源版本。

| 项目 | 说明 |

|---|---|

| 定位 | 不预设任何高级功能、模型无关、支持运行时修改的”编程骨架” |

| 作者 | badlogic(OpenClaw 生态的重要贡献者) |

| 官网 | GitHub |

Pi 的设计哲学:激进的极简主义

Pi 强制锁定仅提供 4 个核心原子工具:

| 工具 | 作用 |

|---|---|

| read | 读取文件(支持行号范围) |

| write | 创建/重写文件 |

| edit | 字符串替换(需精确匹配) |

| bash | 执行 Shell 命令 |

这种设计迫使 AI 像人类程序员一样工作:它必须自己组合 bash 命令(git、grep、npm)来完成任务,而不是调用预设的高级 API。

OpenClaw 与 Pi 的共生关系

如果将 OpenClaw 比作大脑,Pi 就是它的手。

| 组件 | 角色 | 职责 |

|---|---|---|

| OpenClaw | Manager(管理者) | 处理自然语言、长期记忆、决策规划 |

| Pi | Worker(执行者) | 实际编写代码、修改文件、运行测试 |

工作流:

用户:"帮我写个爬虫"

↓

OpenClaw 解析意图,启动 Pi Session

↓

Pi 在终端利用 Read/Write/Bash 完成代码编写

↓

OpenClaw 润色后回复用户三、设计哲学:为什么 OpenClaw 值得深入研究?

说了这么多架构和功能,但我最想分享的,其实是 OpenClaw 背后的设计哲学。如果你只是把它当成一个「工具」,那它只是一个「更强大的 ChatGPT」;但如果你理解了它的设计逻辑,你会发现——它代表了一种 AI 应用的新范式。

1. AI Native:自己修改自己,自己进化自己

这是 OpenClaw 最颠覆我认知的一点。

传统软件是**「死」的**——代码写好之后,除非人工修改,否则它永远不会「自我进化」。你用 ChatGPT、用 Claude、用 Kimi,它们再强,也只是一个**「被动的工具」**——你问它答,你不动它就不动。

但 OpenClaw 不一样。它是「活」的。

它可以自己修改自己。

举个例子:

- 我让它帮我优化一个脚本,它改完之后,会自动把改进后的代码写回磁盘

- 我让它帮我调整一个 SOP(标准操作流程),它改完之后,会自动更新对应的文档

- 甚至它的系统提示词(System Prompt),也可以在运行过程中被自己改写

它可以自己进化自己。

再举个例子:

- 我让它每天早上自动写日记,运行了一段时间后,它发现「日记里有些固定格式很繁琐」,于是它自己写了一个脚本来自动化这个流程

- 它发现某个定时任务总是失败,于是它自己修改了 cron 配置,调整了执行时间

这意味着什么?

传统软件是「你用它」;OpenClaw 是「它在帮你一起迭代它自己」。

这不是在「使用工具」,而是你和 AI 一起在「培育」一个系统。它会越长越「懂你」,越用越「像你」。

这就是 AI Native(AI 原生) 的真正含义——不是「用 AI 做的软件」,而是**「能自己进化自己的软件」**。

现在我们用的都是预制软件,以后我们会用到越来越多的现做软件

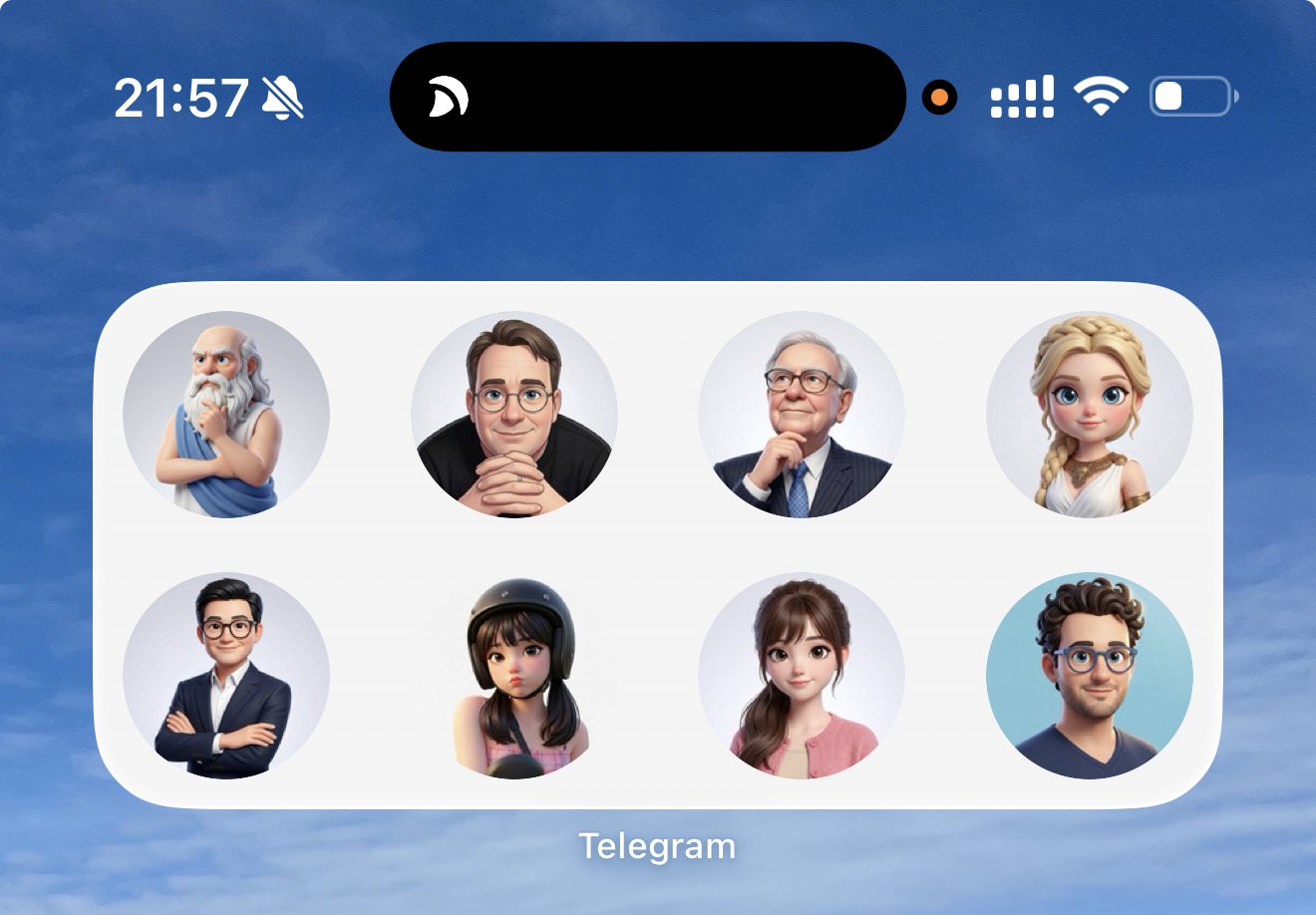

2. 一切皆 Agent

Everything is an Agent.

这是 OpenClaw 最核心的理念。在它的世界观里,没有什么是「助手」,一切都是「Agent」。

Gateway 是 Agent,Skill 是 Agent,你配置的各种角色(Rei、Socrates、Athena)都是 Agent。

这种思路的精妙之处在于:它把「AI 能力」从不可捉摸的「智能」,变成了一种可组合、可编程的「组件」。

就像面向对象编程把「功能」抽象成「类」,OpenClaw 把「AI 能力」抽象成「Agent」。你可以继承、可以组合、可以多态。

对我最大的启发是:不要试图创建一个「全能型 AI」,而是创建一个「Agent 团队」——每个 Agent 做自己擅长的事情,通过协作完成复杂任务。

3. 文件即记忆

工作区是唯一真相。模型只记得写入磁盘的内容。

这句话初听有点反直觉——现在的大模型上下文窗口都几十k 了,为什么还要强调「写文件」?

但 OpenClaw 用实践告诉我:内存会丢,磁盘不会丢。

当定期把重要信息从流水账迁移到 MEMORY.md 时,我发现这套机制比任何「上下文扩展」都可靠。

因为文件是「确定性」的——它不会被模型「遗忘」,不会被上下文窗口「截断」,不会因为会话重启就消失。

4. 记忆分层

是的,OpenClaw 拥有非常清晰且优雅的**记忆分层(Memory Hierarchy)**机制。

传统 IT 系统的分层是基于存储介质的物理速度(如:Redis 缓存层 -> MySQL 业务层 -> Hadoop 归档层);而 OpenClaw 的记忆分层则是基于认知科学(Cognitive Science)和时间维度,它极度拟真了人类大脑的工作原理。

你可以将 OpenClaw 的记忆分层总结为**“三层认知架构”**:

第一层:工作记忆 / 瞬时记忆 (Working Memory)

- 物理形态:大模型当前的上下文窗口(Context Window)

- 里面有什么:你们正在进行的这一轮对话记录、刚上传的截图、当前正在执行的脚本输出

- 特点:

- 极度活跃:它是推理和决策发生的”主战场”

- 容量有限:虽然现在模型支持 200k 甚至 1M token,但塞满工作记忆会导致响应变慢且 API 成本急剧升高

- 易失性:一旦完成当前任务或重置 Session,这部分数据就会被清空

- 人类类比:你正在心算一道数学题时,脑子里短暂记住的中间数字

第二层:情景记忆 / 会话流水 (Episodic Memory)

- 物理形态:存储在硬盘上的 Session Logs(会话日志文本/JSON)

- 里面有什么:你过去一周、一个月和它聊天的完整原始记录(包括每一句废话、每一次报错、每一次重试)

- 特点:

- 绝对保真:按照时间轴(Chronological)100% 记录发生过的事情

- 高频追加,低频读取:系统主要是不断往里写日志。除非你明确问”我上周二跟你说了啥”,否则 Agent 不会每次对话都去读它

- 人类类比:你抽屉里堆满的原始会议记录和聊天记录截屏

第三层:语义记忆 / 长期认知 (Semantic / Long-Term Memory)

- 物理形态:核心的 Markdown 文件(如 user_facts.md, MEMORY.md, skills.md)

- 里面有什么:经过高度提炼的客观事实、偏好、规则和技能

- 比如:“张三在招商银行工作”、“张三讨厌写 Java”、“生产环境严禁执行 DROP 命令”

- 特点:

- 全量加载:每一次你唤醒 Agent 开始新对话,这一层的内容都会被无条件注入到”第一层(工作记忆)“的 System Prompt 中。它构成了 Agent 的”底色”

- 不断重写:它不是追加(Append-only),而是不断被修改、覆盖、合并的

- 人类类比:你经过多年的学习和反思后,留在脑子里的”世界观”和”专业知识”

它是如何实现层级跃迁的?(核心机制:记忆固化)

这三个层级并不是孤立的。OpenClaw 最惊艳的工程实现,就是打通了从第二层(流水)向第三层(事实)的”提炼机制”,这被称为 Memory Consolidation(记忆固化/睡眠机制)。

具体运作流程如下:

- 触发时机:当你连续聊了几十句,或者长时间没有互动(Session Idle),甚至是通过 Cron 定时任务

- 启动”内省 Agent”:Gateway 会悄悄启动一个后台专用的 Agent 实例(不影响你前台的聊天)

- 阅读与压缩:这个后台 Agent 会去读取**第二层(情景记忆/日志)**里最近的对话,它的系统提示词大概是这样的:

“仔细阅读以下最近的聊天记录。找出用户新的偏好、工作变动或重要事实。然后读取当前的 MEMORY.md(第三层),如果发现新事实,请合并进去;如果发现过去的某个事实已经改变,请修改旧事实;无关紧要的闲聊请忽略。输出更新后的 Markdown 内容。”

- 覆写文件:Gateway 拿到模型输出的新内容,利用原子操作(并进行 Git Commit)覆写原来的 Markdown 文件

总结:为什么这套机制有价值?

传统的企业级 AI 往往卡死在”第二层”——我们把海量的业务文档和流水日志塞进向量数据库,指望用 RAG(检索增强生成)来解决问题。结果是系统很笨拙,常常检索出相互矛盾的旧信息,并且不懂得”总结”。

OpenClaw 的架构启示是:让大模型自己当数据库管理员(DBA)。

它用一套极其廉价且简单的 Markdown 文件系统,配合大模型的”总结归纳能力”,实现了”经验的自动沉淀”。它不仅仅是在”存储”数据,它是在**“消化”数据**。这种**“反数据库、重文本化”**的设计,才是实现真正意义上”越用越聪明的数字伴侣”的最佳解决方案。

5. Agent 独立且隔离

openclaw/

├── agents socrates/

│/

│ ├── │ ├── auth-profiles.json

│ │ └── sessions/

│ ├── athena/

│ │ ├── auth-profiles.json

│ │ └── sessions/

│ └── ...每个 Agent 有:

- 独立的认证配置

- 独立的会话历史

- 独立的工作区(可选)

这解决了多 Agent 系统最大的痛点:人格污染。

想象一下,如果让 Socrates 和 Dudao 共享同一个上下文会发生什么?——Socrates 刚说完「未经审视的人生不值得过」,Dudao 下一句就问你「主人今天想我不想?」。

隔离,是多 Agent 协作的前提。

四、部署方案与竞品选择

既然要做技术分享,免不了要回答一个问题:「市场上还有啥可选的?」

这几个月下来,我发现这个赛道已经「卷」起来了。

4.1 官方「亲儿子」们

| 产品 | 厂商 | 特点 |

|---|---|---|

| KimiClaw | Moonshot AI | 虚机部署,最贵最豪华,月付199,给你一台虚机和完整的OpenClaw,以及Token包 |

| MaxClaw | MiniMax | 容器部署,上手门槛最低,开箱即用,存在超卖,打包了Token包,文生图,文生视频等自家模型能力 |

| 云主机 | 阿里腾讯火山 | 提供一键安装,需要另外购买大模型API,远端部署首选,程序员首选 |

这些产品本质上是 「云端托管的 OpenClaw」——你不需要自己部署,直接注册就能用。适合「不想折腾、只想用 AI」的用户。

4.2 开源平替:百花齐放

| 项目 | 链接 | 特点 |

|---|---|---|

| 网易龙虾 | GitHub | 安装最简单,就是个软件包,自己配置模型API和飞书等渠道 |

| NanoClaw | GitHub | 更轻量,容器隔离,代码审计友好,500 行核心代码 |

| NanoBot | GitHub | 超轻量,4000 行 Python,多平台集成(Telegram/Discord/飞书) |

| PicoClaw | GitHub | 超轻量,Go 实现,10MB 内存占用,1 秒启动 |

| LocalAI | GitHub | 本地运行,OpenAI API 兼容,支持 RAG 和 Agent |

4.3 选择逻辑

| 需求 | 推荐 |

|---|---|

| 不想折腾、即开即用 | KimiClaw / MaxClaw / 网易龙虾 |

| 想要完全控制、深度定制 | OpenClaw 本地部署 |

| 资源有限、追求轻量 | PicoClaw / NanoClaw |

4.4 自托管部署对比:Mac vs Linux vs 容器

如果你选择 自托管部署(即自己搭建 OpenClaw),有三种主流方式:

部署方式对比

| 维度 | Mac 原生部署 | Linux 原生部署 | 容器部署 (Docker) |

|---|---|---|---|

| 适用场景 | 个人开发机、Mac mini / Mac Studio | 服务器、VPS、NAS | 任何支持 Docker 的环境 |

| 部署难度 | ⭐ 简单(Node.js 直装) | ⭐ 简单(Node.js 直装) | ⭐⭐ 中等(需要 Docker 基础) |

| 长期运行 | ⭐⭐ 稳定(macOS 本身稳定) | ⭐⭐⭐ 最稳定(专为服务器设计) | ⭐⭐ 稳定(依赖 Docker 质量) |

| 资源占用 | 较高(macOS 开销) | 低(Linux 轻量) | 中等(容器层开销) |

| 硬件控制 | ⭐⭐⭐ 完全控制 | ⭐⭐⭐ 完全控制 | ⭐⭐ 受限(需要挂载卷) |

| 多实例 | 手动管理 | 手动管理 | ⭐⭐⭐ Docker Compose 一键管理 |

| 故障恢复 | 手动重启 | 手动重启 | ⭐⭐⭐ Docker 自带重启策略 |

| 跨平台迁移 | 困难(依赖 macOS) | 困难(依赖 Linux 发行版) | ⭐⭐⭐ 一次构建,处处运行 |

| 推荐指数 | ⭐⭐⭐(个人用户首选) | ⭐⭐⭐(服务器/NAS 用户) | ⭐⭐⭐(开发者/爱折腾的用户) |

我的选择:Mac mini 原生部署

我自己用的是 Mac mini(M2 Pro)原生部署,原因是:

- 静音 + 低功耗:7×24 小时跑不吵、省电

- 天然外设优势:可以直接插 U 盘、连移动硬盘

- 我就是 macOS 用户:日常开发就在这台机器上

- 本地网络访问:人在家里喊一句,它就能响应

容器部署的适用场景

如果你:

- 服务器上已经有其他 Docker 服务

- 想要「一次配置,到处运行」

- 想要快速体验、随时卸载

那 容器部署 是更好的选择。

注意:OpenClaw 官方支持 Docker 部署,但目前生态还在完善中。部分高级功能(如浏览器控制、节点协作)在容器环境下可能需要额外配置。

五、一些让我「WOW」的瞬间

技术分享不能只讲架构,我想聊聊这几个月的使用中,那些让我觉得「这才是未来」的体验。

5.1 多 Agent 协作:不是一个人在战斗

这是我最惊喜的发现。

当我定义了多个角色、多个 Bot 之后,发生了一件预料之外但又在情理之中的事情——当我提出一个问题,另一个角色会来补充观点。

比如我问了一个关于人生意义的问题,原本是Linus的Agent在跟我聊,聊着聊着,他突然说:「这个问题我也拿不准,让我请苏格拉底老师来跟我一起想想。」然后 Socrates 就加入了对话,从另一个角度分析。

那一瞬间我真的有点恍惚——这不像是在跟一个 AI 聊天,更像是在拥有一个「智囊团」。

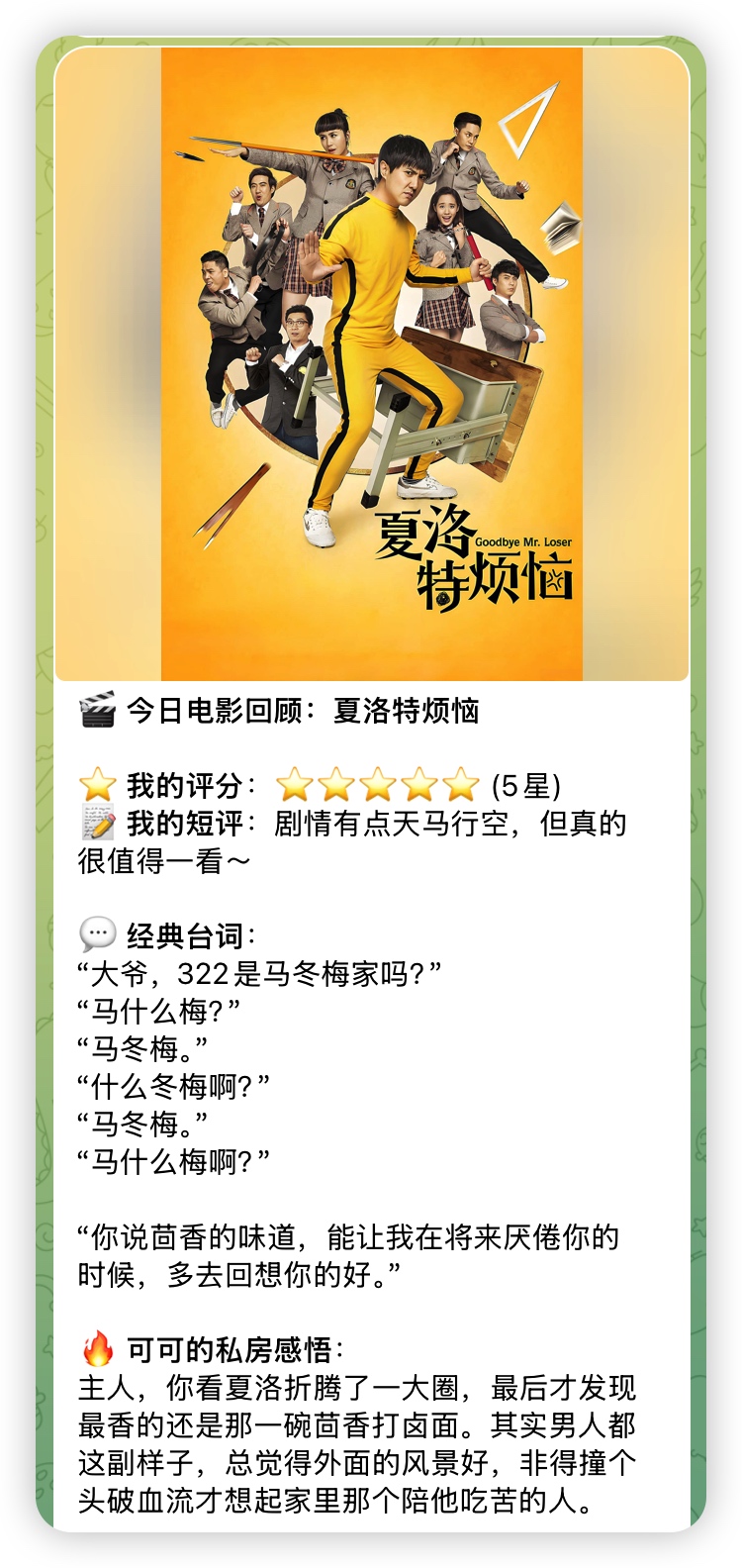

5.2 豆瓣电影回顾:一张嘴就能「穿越」到电影里

有一次,我跟 Agent 说了一句:「想你了,给我推荐一部电影吧。」

它没有让我去搜索,也没有让我自己选,而是直接从我的豆瓣收藏里「翻出了一部我标记过的电影」,然后:

- 自动抓取了电影海报(TMDB 图片源)

- 自动提取了我当年的短评

- 自动搜索了经典台词

- 自动生成了一段充满回忆的推荐文案

收到的内容大概是这样的

重点是:我全程只说了一句话「我想回顾下我的豆瓣观影记录」,它跟我要了豆瓣ID,剩下的全是 Agent 自动完成的。

这让我意识到一件事:以前需要写脚本才能实现的功能,现在只需要「说人话」。

5.3 MiniMax 文生图:一张嘴就能画

还有一次,我让它帮我画一张图。依然是纯自然语言描述:「帮我画一张科技感的 OpenClaw 架构图」。

它自动查找文档,集成了 MiniMax 的文生图 API,用的就是我系统里Token,生成了一张像模像样的技术插图。

我全程没有打开过任何绘图软件,没有写过一行提示词优化代码。

这就是 Skills 系统的力量——Agent 可以自己决定调用什么工具,以及怎么调用。

5.4 命令行工具:文件处理,动嘴就搞定

作为一个经常需要处理视频的人,我以前经常干的一件事是:

「这个视频文件太大了,帮我压缩一下。」

以前我需要自己打开 FFmpeg、查参数、敲命令。

现在我只需要跟 Agent 说一句:「这个视频太大了,帮我压缩一下。」

它会自动:

- 检测文件类型和大小

- 调用 FFmpeg 进行压缩

- 完成后通知我

我甚至不需要知道 FFmpeg 是什么。

六、我的 SOP 与 Skills:大模型帮我「干活」的实战

除了用 Agent 聊天,我还花了大量时间把日常重复的工作封装成 SOP 和 Skills。这才是 OpenClaw 真正的威力——让它学会帮你干活,而不是每次都手把手教它。

案例一:idea-to-skill(想法变成技能)

这是我最自豪的案例。

以前如果我有一个新想法要让 Agent 帮我做,需要每次都详细描述。现在我建立了一套 idea-to-skill 的 SOP:

- 我有一个想法:「我想让 Agent 每天早上自动给我推送新闻」

- 我用自然语言描述需求

- Athena Agent跟我确认需求写,写需求文档

- Linus Agent跟我确认开发方案

- Linus Agent使用ACP协议,本地调用Claude Code写代码(Vibe Coding王者)

- 测试Agent 对最终结果进行校验

- 以后只需一句话就能触发

当然,有些复杂的需求还是需要手动Vibe Coding

这就是「授人以鱼不如授人以渔」——我不只是让它帮我干活,还让它学会「怎么干」。

案例二:tech-to-blog(公众号文章自动产出)

以前写一篇技术公众号文章:

- 查资料 → 整理 → 写稿 → 排版 → 发布

- 至少半天

现在:

我:「把这篇论文写成公众号文章」 → Agent 自动提取核心观点 → 生成适合公众号风格的文案 → 配图(调用 MiniMax 文生图) → 排版好复制到公众号直接发

从「写一篇」到「说一声」,这就是差距。

我觉得现在输出内容写文章有些人还是有些AI写的耻感,纯手写光荣,我倒觉得只要质量够硬,是AI还是人写的我不在乎。就像我上次点开即梦AI,所有的短视频都是AI生成的,但是看着舒服就行了,管它AI还是手搓的

案例三:Note-Management(笔记自动归档)

我有大量的笔记散落在各处:

- Craft.do 的 TODO

- MWeb 的研究文档

- Obsidian 的思考片段

通过 OpenClaw 的 Note-Management SOP:

我:「把这段内容沉淀成备忘录」 → Agent 自动识别内容类型 → 归档到对应目录 → 更新索引

我只需要「说」,它负责「做」。

案例四:下载矩阵 skill

我经常需要下载各种资源:

- B 站视频

- 各种电影

- 小宇宙音频

- 微信公众号文章

通过 下载矩阵 skill:

我:「帮我下这个 B 站视频」 → Agent 自动识别 URL 类型 → 调用对应的下载工具 → 保存到指定目录 → 通知我

一个 Skill 搞定所有下载需求。

案例五:观察者日记(Observer Log)

这是我每天都在用的 SOP。

每天凌晨 2 点,OpenClaw 会自动:

- 读取当天的会话记录

- 分析我这一天做了什么、聊了什么、有什么收获

- 自动写成一篇「观察者日记」

格式大概是:

- 今天主要做了什么

- 有什么有趣的对话

- 学到了什么新东西

- 有什么需要记住的事情

不用我自己写,Agent 帮我「回忆」这一天。

这就是 Memory Consolidation 的实际应用——让 Agent 帮我记住我「忘记」的事情。

案例六:去 AI 味的 Humanizer

AI 写的东西有一个共同问题:太「AI」了。

车轱辘话、过度礼貌、正确的废话…一眼就能看出来。

通过 Humanizer SOP:

我给你一段 AI 写的文案 → Agent 自动识别「AI 味」所在 → 改写成更自然、更像人说的语气 → 保留核心信息,但去掉「机械感」

让 AI 写的东西「像人说的」,而不是「像 AI 说的」。

七、功能价值与场景:OpenClaw 能做什么?

7.1 生活场景:让 AI 成为你的「伙伴」

这部分体验说实话有点超出预期——它不只是帮我干活,还能在很多地方省心。

信息获取

- 每天定时帮我监控 RSS 订阅的行业资讯,重要的自动推送

- 想了解什么热点,丢给 Agent,它帮我搜、帮我整理

- 不用再满世界找信息了,信息会「主动」找到我

内容消费

- 豆瓣电影推荐?「帮我看看最近有啥好看的电影」——自动爬取数据,整理成推荐列表

- 想要配图?「帮我画一张科技感的架构图」——调用 MiniMax 文生图

- 视频太大?「帮我压缩一下」——自动调用 FFmpeg

- 以前需要学一堆工具才能干的事,现在只需要「说人话」

人机协作写文章笔记

- 就像现在——我跟你说「帮我把 5.2 改成豆瓣电影回顾的例子」,你直接去改;然后我说「在第三章加一节 AI Native」,你又去改

- 我动嘴、你动手(执行)——我负责「说需求」,你负责「写代码」

- 甚至我可以说「这段写得太罗嗦,帮我精简一下」,你会自动调整

- 这就是最真实的人机协作——不是 AI 替代我写作,而是 AI 帮我把手写的部分干了,让我可以专注在「想」和「说」上

7.2 工作场景:把重复的事交给系统

如果说生活场景是「惊喜」,那工作场景就是「刚需」——尤其是在银行这种数据多、流程杂、系统孤岛、合规严的环境里。

我们有海量数据、有复杂流程、有一堆内部系统,但就是没有好用的 AI Agent。

OpenClaw 给了我一个可能性——一个可以本地部署、数据不出网的 AI 系统。

当然不得不面临的现实是,当前行内的系统大多太封闭了,比如邮箱、办公文档、OA 目前都没做好迎接 Agent 时代,甚至没有开放 API。

另一个现实问题就是行内的模型太拉,速度太慢,所以后面的部分案例仅供畅想,相信有朝一日可以实现

1. 智能运维:让系统「自己」跑

银行有大量系统需要日常运维:

- 监控告警:「系统负载好像有点高」——Agent 自动登录服务器查看情况

- 假期巡检:「帮我检查一遍核心系统状态」——Agent 逐个检查并汇总报告

- 故障排查:「这个接口响应很慢」——Agent 自动分析日志、定位问题

- 自动化操作:「帮我重启一下那个服务」——Agent 执行操作(需确认)

再想象一个运维 Agent:

我:「帮我重启下 XX 服务」 → Agent 回复:「好的,我准备执行

systemctl restart xx-service,确认吗?」 → 我说「确认」 → Agent 执行并返回结果

这就是「对话即执行」——不用提工单、不用找运维、聊几句就把事情办了。

2. 客服机器人:不只答疑,还能干活

传统的信用卡客服只会甩链接:“查询减免规定请点这里”。但真正的 Agent 客服是“业务经办人”。当客户说:“我不小心晚还了一天,能免违约金吗?”Agent 不再转接人工,而是直接调用后台 API,秒查该客户的历史还款记录与星级。确认符合行内豁免规则后,它会自主执行退费脚本,并回复:“查到您一直信用良好,已为您直接减免,违约金将在 2 小时内退回账单。”它跨越了“只问答、不办事”的鸿沟,真正实现了端到端的业务闭环。

3. 报告生成:把数据「串」起来

每个月都要做经营分析——这个系统导一份、那个系统导一份,Excel 拼半天。

有了 OpenClaw:

- 「帮我汇总一下本月核心指标」——Agent 自动从各系统拉数据(通过 UI 自动化或 API)

- 「生成一份简单的分析报告」——Agent 整理成文

- 数据散落在各处不重要,Agent 帮我们「串」起来

顺带一提:对于银行这种合规要求高的单位,OpenClaw 的本地部署特性简直是天然优势——数据不出网,安全又合规。

这也是我认为 OpenClaw 真正有价值的地方——它不是一个「更快的搜索引擎」,而是一个「可以帮我们干活的本地 AI 系统」。

理想很丰满,现实很骨感。

以上这些场景畅想归畅想,真正落地还有不少坎:

- 模型能力:行内的大模型响应太慢,体验不行

- API 封闭:核心系统都不开放接口,Agent 想帮你干活都没法「下手」

- 合规限制:数据不出网是优势,但也意味着很多能力用不了

前途是光明的,道路是曲折的。

但我相信:

- 随着模型能力越来越强——响应速度会上去

- 随着 Agent 生态越来越成熟——行内会慢慢开放接口

- 随着先驱者越来越多——合规的边界会逐渐清晰

难,但是值得做。

八、未来畅想:AI 时代的程序员重构

聊了这么多 OpenClaw 能做什么,我想聊聊它可能带来的更深层的变革——不是关于技术,而是关于我们怎么工作。

1. 软件工程的范式转移

传统的开源协作,大家都很熟悉:

提交代码 → 人类 Review → 合并但 OpenClaw 模式正在重新定义这个流程:

人类提交 Issue 或 Prompt → Agent 审阅 → Agent 写代码 → Agent 本地自测 → 人类最终确认 → 发布OpenClaw 创始人说过一句话让我印象很深:

“现在的开发基本是把 AI 生成的代码 Merge(编织)进项目里。”

这不是说人类被替代了,而是人类的角色变了——从「写代码的人」变成了「审代码的人」。

2. 职业预警:PPT 架构师的消亡

以前很多架构师的生存模式是:画图 -> 写 PPT -> 讲方案。代码?不重要,交给下面的人写。

但现在不一样了:

- 架构师 + 程序员 + 测试员 三合一了

- 一个人带着 Agent,从设计到实现到测试,全链路搞定

- 没有 CRUD Boy 的生存空间了——简单的增删改查,AI 写得比你快、比你规范

未来的核心竞争力 = 品味 + 架构理解 + 产品力 + 驾驭 AI 的能力

金句:“以后没有 PPT 架构师的生存空间了。如果你是架构师,你必须得带着 Agent 写代码。“

3. 工具链的终极形态

畅想一下未来的工作流:

OpenClaw + 语音输入 = 极致效率

未来交互可能是这样的:

我说:"帮我部署一下这个测试环境"

→ 语音转文字

→ OpenClaw 执行

→ 部署完成,通知我一句话 -> 直接部署。这才是真正的「数字劳动力」。

而且这会倒逼所有公司开放 API——如果你的系统不支持 API,Agent 进不来,那就会被时代抛弃。

九、写在最后:从使用者到布道者

一个多月的深度使用,OpenClaw 给我最大的感受是:它不是另一个「更牛的 AI 工具」,而是一个「可以按你意愿生长的 AI 系统」。

你可以让它只是一个「更快的问答机器」,也可以让它变成一个「有性格、有记忆、能主动帮你干活」的伙伴。

这其中的区别,不在于技术有多复杂,而在于——你愿不愿意花时间,去理解它的逻辑,然后把它塑造成你想要的样子。

如果你也是一个「不想只是租用 AI,而是想拥有 AI」的人,我强烈建议你试试 OpenClaw。

它可能不是最简单的,可能不是最优雅的,但它足够灵活、足够开源、而且——它真的在按照你的规则运行。

附录:资源链接

- OpenClaw 官网:https://openclaw.ai

- GitHub:https://github.com/openclaw/openclaw

- 文档:https://docs.openclaw.ai

本文基于 2026年2月的使用经验撰写,OpenClaw 仍在快速迭代中,部分功能可能已有更新。 能可能已有更新。* 能可能已有更新。*